Cannes blanche électronique

Près de 300 millions de personnes sont malvoyantes à travers le monde et à côté de cela, des chercheurs travaillent dur pour ajouter la vision aux robots. Jagadish Mahendran, de l’Institut d’Intelligence Artificielle, à l’Université de Georgie, trouve cette situation plutôt … ironique.

C’est en 1930 que Guilly d’Herbemont constate que les personnes malvoyantes de son quartier parisien courent un grave danger à chaque fois qu’ils sortent de chez eux. Les véhicules motorisés prennent de plus en plus de place dans la ville. En s’inspirant des bâtons blancs des gendarmes dévoués à la circulation, elle invente la canne blanche afin d’attirer l’attention. C’est plus tard que cette canne blanche servira également à balayer son environnement pour détecter les obstacles. Une canne blanche, malgré ce que pensent les voyants, n’est pas réservée aux personne en cécité totale. Elle permet avant tout d’indiquer l’handicape et donc qu’il faut en prendre compte dans son propre déplacement. D’ailleurs, cette signalisation visuelle est également un frein pour son adoption pour certaines personnes malvoyantes qui n’ont pas forcément envie d’afficher leur handicape.

Il existe déjà des assistants utilisant la technologie pour aider les personnes malvoyantes à se déplacer dans la rue. Elles permettent à leurs porteurs de ne pas être obligé d’aller jusqu’au contact pour ressentir les obstacles.

L’Ultracanne est une canne blanche électronique qui repère les obstacles grâce aux ultra-sons. Elle détecte les obstacles qui peuvent surgir aux pieds de son utilisateur ou bien qui pourraient toucher l’utilisateur sur le haut du corps. La canne perçoit sur des distances qui se comptent jusqu’à 4 mètres. La canne prévient son utilisateur en faisant vibrer plus ou moins fort un des deux boutons situés sous le pouce. Un bouton pour les obstacles situé vers le bas et un autre pour les obstacles pouvant gêner le haut du corps.

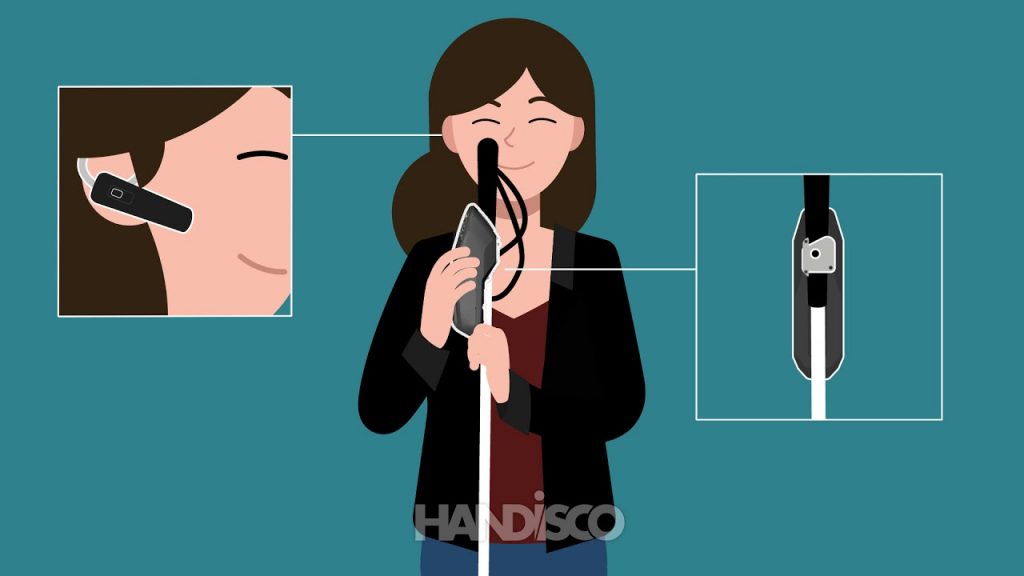

La canne blanche Sherpa utilise plutôt le son à travers une oreillette bluetooth. L’appareil fonctionne comme un assistant vocal de type Alexa ou Google Home. L’utilisateur pilote l’appareil par la voix et reçoit des informations liées à sa situation GPS. L’oreillette peut lui indiquer l’heure d’arrivée du prochain bus, la distance et l’orientation pour rejoindre une adresse, des monuments ou des rues. L’orientation est indiquée en heure. ‘Douze heure’ étant la direction pour aller vers l’avant, ‘3 heures vers la droite’, ‘9 heures vers la gauche’ et ‘6 heures’ indique qu’il faut faire demi-tour. La canne indique également à son utilisateur la couleur du feu des piétons.

La jeune startup GoSense a développé un bouclier virtuel intelligent sous la forme d’un boîtier équipés de capteurs à ultra-sous, à installer sur le manche de n’importe quelle canne blanche du marché. Elle propose à son utilisateur de percevoir son environnement avec un système audio en réalité augmentée. L’environnement est retransmit sous forme d’un son spatialisés dans un casque audio. Chaque obstacle est retranscrit par un cliquetis qui est perçu dans la direction de celui-ci, incluant sa hauteur. La vitesse du cliquetis donne la notion de distance. Cela permet de se faire une image mentale virtuelle de son environnement. La partie intelligente est sous-traitée par un smartphone caché dans la poche. L’application va également donner des informations audios sur le lieu détecté par son GPS, comme les horaires des trams et autres bus.

C’est quoi la différence entre les embouts ?

Effectivement, les cannes blanches possèdent trois type d’embouts principaux, suivant le terrain. Le plus petit est fixe, il glisse sur le sol et est parfait pour être utilisé dans un bâtiment, sur un béton lisse, un plancher ou un carrelage avec peu de relief. A l’extérieur, ces embouts ne pourront servir qu’à se signaler.

Les embouts tournants simples, que certains appellent guimauve à cause de leur forme et consistance, tournent autour de leur axe central et roulent pendant le balayage. C’est l’embout le plus utilisé car il assiste le mouvement de balayage sur des sols rugueux intérieurs comme extérieurs.

Enfin, la rolling ball est un embout tournant un peu plus gros, en forme de boule. Elle servira principalement sur des trottoirs en mauvais état, des chemins en terre ou du sable.

Au fait, cela veut dire quoi les dalles aux sol ?

Tu as raison d’ouvrir ici cette parenthèse. Vous avez dû remarquer les dalles striées que l’on perçois sur certains trottoirs, notamment près des carrefours ou à la sortie des supermarchés ? Ce sont en réalité des parcours podotactiles pour les personnes malvoyantes qui balayent ces dalles. Elles donnent des indications grâce à leur relief. Les dalles striées indiquent le sens de la marche.

Des dalles en caoutchouc ou un simple espace vide de 70 cm de côté vont indiquer un embranchement de parcours podotactiles emmenant dans des directions différentes.

Des dalles recouvertes de plots indiquent une alerte, qui invite à s’arrêter. Cela peut-être avant un passage piéton, en haut d’un escalier ou à un point remarquable, qui peut être un guichet d’information, un arrêt de transport en commun ou une borne d’appel.

Je reviens maintenant sur Jagadish Mahendran, de l’Institut d’Intelligence Artificielle, à l’Université de Georgie, dont nous avons parlé tout au début. Face à l’ironie de développer la vue aux robots alors que 285 millions de personnes sont malvoyantes sur Terre, il décide de mettre ses connaissances et la technologie à leur service.

Jagadish utilise OpenCV, une bibliothèque graphique libre développée par Intel, capable de traiter les images en temps réel. Ces images sont filmées par deux caméras avec détection de profondeur OAK-D, semblable aux capteurs Kinect de la Xbox. Celles-cis sont logée discrètement sous un vêtement au niveau de la poitrine et dans un sac banane. Un ordinateur et sa batterie d’une durée de travail de 8h sont placés dans un sac à dos équipé d’un récepteur GPS. Il récupère les données des caméras et traite leurs images en direct par une intelligence artificielle qui renvoie le résultat de son analyse, via une voix synthétique, dans une oreillette bluetooth.

Le système détecte l’ensemble des obstacles, lit les panneaux et détecte les changements de dénivellation, comme un trottoir. A un passage piéton, l’appareil détecte le couloir des piétons et guide son utilisateur dans sa direction. La petite voix va donc donner continuellement des informations sur ce qu’elle perçoit. Elle vous dira d’éviter un obstacle par la droite ou la gauche ou de baisser la tête pour éviter un feuillage. Ce sont des messages très courts. Sur notre exemple de feuillages au niveau de la tête, la voix va juste signaler « top front » ce qui signifie qu’un obstacle est devant en haut. Il faudra donc baisser la tête.

Dans la rue, l’intelligence artificielle pourra, suite à une demande vocale de votre part, vous décrire ce qu’elle voit. La reconnaissance des formes va entrer en action et vous décrire les obstacles, les feux de signalisation, les parcours podotactiles, les personnes, animaux ou véhicules sur votre chemin. Chaque élément est indiqué avec sa direction en heures.

Si vous lui demandez votre localisation GPS, il vous indiquera votre adresse géographique et pourra vous guider à un lieu précis.

Ce système est encore en cours de développement et est testé dans la banlieue de Los Angeles en Californie. Le but est ici de se passer d’un chien d’aveugle et même d’une canne blanche. Il se veut discret afin qu’à l’avenir ses utilisateurs n’aient plus besoin d’être particulièrement visibles pour se déplacer en toute sécurité.

Ces recherches ne déboucheront probablement pas d’un produit avant quelques années encore. La canne blanche a encore un peu de répits avant de partir à la retraite.

Space Perspective

Peut-être rêvez-vous de monter assez haut afin de voir la courbure de la Terre ? Le tourisme spatial qui devrait émerger dans les prochains mois avec la petite navette SpaceShipTwo de Virgin Galactic, la capsule NewShepard de Blue Origin ou les vols dans la Station Spatiale Internationale avec Space Adventure qui seront proposés à des tarifs très élevés. 250 000 € pour un saut de puce et plusieurs millions pour un séjour en orbite.

Space Perspective, une entreprise américaine, propose une nouvelle voie pour un tarif un peu moins élevé. Pour la moitié de la valeur d’une place dans SpaceShipTwo ou New Shepard, soit environ 120 000 €, vous pourrez vous envoler dans une nacelle pressurisée attachée à un ballon stratosphérique jusqu’à une altitude de 30 km, assez pour voir distinctement la courbure de la Terre et avoir une vue proche d’un passager d’une mission spatiale.

La nacelle, appelée Neptune, peut embarquer 8 personnes, elle contient un bar et des toilettes et offre une vue panoramique sur notre planète. Après le décollage depuis la Floride, le ballon mettra deux heures pour atteindre les 30 km d’altitude. Vous resterez ensuite pendant 2 heures à admirer notre planète et sa fragilité, dans les hautes couches de l’atmosphère en dérivant en direction de l’océan atlantique. Puis vous redescendrez pendant 2 heures supplémentaires jusqu’à l’océan où un bateau vous récupérera.

Space Perspective prévoit que, parmi sa clientèle, certains voudront en profiter pour y célébrer des évènements de groupes comme des mariages ou des concerts. Il est également possible que Neptune soit utilisé de temps en temps pour des études scientifiques sur l’atmosphère, le climat ou la météorologie.

Pas de soucis pour vos réseaux, vous pourrez accéder à Internet à tout moment et donc aux réseaux sociaux pour vous pavaner avec la Terre en fond.

Le tarif est moitié moindre que Virgin Galactic ou Blue Origin, mais Neptune ne va pas jusqu’à l’espace situé à 100 km d’altitude, et encore moins en orbite. Vous ne pourrez donc pas goûter aux joies de l’apesanteur, vous aurez toujours les pieds au sol. Je dirais même que si vous ressentez une apesanteur, c’est qu’il y a un problème, c’est que vous tombez, tout simplement ! Par contre, ce voyage de 6 heures en tout est bien plus long que les sauts de puces spatiaux qui se déroulent en moins de 3 heures pour Virgin Galactic et en moins de 15 mn pour Blue Origin, les deux avec seulement quelques minutes réellement dans l’espace.

L’entreprise a fait une dernière levée de fonds de 7 millions de dollars en décembre dernier. Le premier vol devrait avoir lieu dans les prochains mois avec une nacelle vide et non pressurisée afin de valider le concept. Les vols commerciaux pourraient commencer à partir de 2024.

Mars Smiley

Peut-être évitez-vous de regarder le mini-rayon bonbons et chocolats que l’on trouve à l’entrée des caisses de supermarchés pour ne pas être tentés de prendre une barre chocolatée. La société Mars, qui produit de nombreuses confiseries comme les barres Mars ou les M&Ms a bien compris que vous aviez appris à ne pas vous faire avoir par la tentation.

C’est pourquoi elle teste un robot pour vous appâter à l’intérieur même des magasins. Le robot Smiley est dérivé des robots du constructeur Relay de Savioke, qui s’occupe de petites livraisons dans les hôtels ou des entreprises.

Je sens que ce robot Smiley va vite devenir énervant dans les magasins car celui-ci suit les clients et les invite à se servir d’un paquet de confiserie dans l’étalage qu’il transporte.

Vendre des bonbons n’est pas sa fonction principale. En réalité, il est surtout là pour étudier les déplacements et habitudes des clients dans le magasin. Ils proposent ainsi aux propriétaires un moyen d’améliorer leur magasin pour coller au mieux aux habitudes de ses clients.

Le robot Smiley est pour le moment en période de test dans un magasin alimentaire ShopRite à New-York.

Pas sûr que ces étalages mobiles donnent une bonne image du robot, surtout si on imagine un magasin où plusieurs robots de ce type seraient déployés. C’est légèrement anxiogène, même pour moi.